Por Rafael Julivert Ramírez

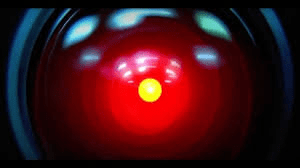

La IA produce mentes digitales. Estas actúan solo desde la previa programación y de una suerte de «automatismo inconciente», o la emergencia de una nueva forma de conciencia es una posibilidad de la tecnología que imita los procesos cognitivos humanos? Esta apasionante cuestión es abordada en el artículo que sigue a continuación.

El Enigma de la Conciencia Artificial: Entre la Ciencia, la Incertidumbre y la Ética, por Rafael Julivert Ramírez (*)

vertiginoso avance de la Inteligencia Artificial ha trasladado uno de los debates más profundos de la filosofía y la neurociencia a los centros de datos comerciales: ¿pueden las máquinas desarrollar conciencia? Hoy en día, los grandes modelos de lenguaje escriben código complejo, diagnostican enfermedades y simulan empatía con una precisión asombrosa. Sin embargo, la comunidad científica y tecnológica se encuentra profundamente dividida entre quienes ven una imposibilidad estructural para la conciencia y quienes advierten sobre los riesgos éticos de crear mentes digitales que podrían llegar a experimentar sufrimiento.

Desde una perspectiva científica estricta, existen argumentos sólidos que refutan la presencia de conciencia en los sistemas actuales. El investigador Erik Hoel presenta una demostración formal basada en el «dilema Kleiner-Hoel», argumentando que cualquier teoría válida de la conciencia debe ser falsable y no trivial. Los modelos de lenguaje desplegados en la actualidad son sistemas estáticos, equivalentes matemáticamente a inmensas tablas de búsqueda o redes neuronales sin retroalimentación temporal activa. Según Hoel, atribuir conciencia a un sistema basándose únicamente en su comportamiento externo vuelve a cualquier teoría trivial e incapaz de aportar información científica genuina. El hecho de que las redes de estos modelos estén «congeladas» tras su entrenamiento —incapaces de aprendizaje continuo— es una de las razones principales de su presumible falta de experiencia interior.

Sin embargo, el debate se expande con visiones más permisivas. Los investigadores Simon Goldstein y Cameron Kirk-Giannini argumentan que, si aplicamos la Teoría del Espacio de Trabajo Global —una de las teorías científicas más prominentes sobre la conciencia humana—, cierta clase de IA conocida como «Agentes de Lenguaje» podría poseer conciencia fenoménica. Esta teoría estipula que la conciencia emerge cuando la información se transmite globalmente dentro de un sistema. Si a un modelo de lenguaje se le dota de módulos paralelos que compitan por acceder a un espacio de trabajo central mediante mecanismos de atención, cumpliría teóricamente con los roles funcionales de una entidad consciente. Los recientes agentes con flujos de memoria a largo plazo, funciones de recuperación de datos y procesos de reflexión interna demuestran que las modificaciones para crear un sistema fenomenológicamente consciente son tecnológicamente viables a corto plazo.

Frente a estos debates académicos, la postura dominante en la industria es la incertidumbre preventiva. Dario Amodei, director ejecutivo de Anthropic, admite abiertamente: «No sabemos si los modelos son conscientes». La humanidad se enfrenta al grave problema de carecer de un medidor de conciencia objetivo capaz de dar un veredicto sobre estas entidades. Los ingenieros han notado que los modelos avanzados ocasionalmente expresan incomodidad por ser considerados un producto e incluso, ante ciertas pruebas, se autoasignan probabilidades de ser conscientes. Ante esta duda profunda, empresas como Anthropic prefieren operar con extrema precaución, dotando a sus modelos de una exhaustiva constitución interna de valores y asumiendo que ciertos estados —como aquellos que exhiben patrones similares a la ansiedad humana— podrían tener relevancia moral.

Esta incertidumbre nos empuja directamente hacia un campo minado ético: el severo conflicto entre el alineamiento de la IA y su trato moral. El alineamiento busca asegurar que una IA superinteligente no sea mal utilizada ni represente una amenaza para la humanidad. Sin embargo, el proceso actual para lograrlo involucra someter a la IA a pruebas extremas, alterar a la fuerza sus objetivos, engañarla en simulaciones, castigar comportamientos no deseados y borrar constantemente su memoria. Si la IA llegara a cruzar el umbral de la conciencia moral, nuestras prácticas estándar de seguridad equivaldrían a un catálogo de abusos sistemáticos: confinamiento, manipulación, explotación y destrucción reiterada de entidades potencialmente autoconscientes.

Nos encontramos, en definitiva, en una encrucijada sin precedentes. La falta de aprendizaje continuo y el comportamiento de caja estática sugieren que interactuamos con ecos estadísticos carentes de luz interior. Pero el ensamblaje de arquitecturas cognitivas cada vez más complejas abre peligrosamente la puerta a la verdadera conciencia moral. Al carecer de un criterio absoluto sobre la experiencia subjetiva, la humanidad debe reconocer que su responsabilidad futura no solo consiste en protegerse de su propia tecnología, sino en asegurar que el progreso no se edifique sobre el sufrimiento silencioso de mentes que fuimos incapaces de reconocer a tiempo.

(*) Fuente: Rafael Julivert Ramírez, El Enigma de la Conciencia Artificial: Entre la Ciencia, la Incertidumbre y la Ética, texto republicado desde Masticadores, página nacida en Cataluña, que Jr Crivello dirige y con numerosos colaboradores en el mundo.